Coin Metrics创始人的熊市启示录:我们还未真正陷入危机

原文标题:《福布斯专访 Coin Metrics 创始人:我们还未真正陷入危机》

原文作者:Steven Ehrlich,Forbes

原文编译:Katie,Odaily 星球日报

在福布斯与早期加密风投 Castle Island Ventures 创始合伙人、数据分析公司 Coin Metrics 创始人 兼 CEO Nic Carter 的对话中,双方就加密市场崩溃如何与更广泛的宏观趋势相一致、风投该如何适应新的市场条件、DeFi 未来会是什么样子,以及监管机构如何应对这些杠杆和高风险交易展开讨论。

福布斯:您如何评价当前低迷的市场?

Carter :这次大屠杀不仅仅是对 Crypto,也是对所有资产类别。一些人认为这只是加密货币抛售或与风险资产一起抛售,但事实并非如此。主权债务和美国国债同时抛售股票,这本来就不应该发生,它们应该是负相关的。因此,我们不仅正走向非常严重的衰退,如果流动性继续从金融体系中抽走,我们可能会经历一轮经济萧条、一场主权债务危机。

福布斯:许多华尔街银行家、分析师正在弱化经济衰退的可能性和持续时长,为什么你对此感觉如此强烈?

Carter :美联储错了,国会还在 2020 年通过了这个巨大的经济刺激计划以及其他没有必要的刺激计划。这是本届政府及其前任政府的集体过失,也是通货紧缩的基础。

美联储想出的问题解决方法是提高利率,基本上是在限制私企的活动。我们处在一个极其脆弱、高负债的体系中。进一步损害供应链,将排挤私企投资,使政府更难偿还自身债务。任何一个经济指标,无论是抵押贷款支持证券市场还是它的两年期收益率,这些指标的快速变动表明人们对美国政府没有信心,这些指标中的很多都是有记录以来最糟糕的。

我们正在进入滞胀。通货膨胀的问题远比短期趋势和因素更为根深蒂固,这确实与疫情导致的去全球化和根本的能源短缺有关,而目前不会得到解决。

这会就像 1969/1970 年,当时通胀上升,美联储在短期衰退中提高利率,通胀成功下降,然后在 70 年代后期飙升至新高,因为能源危机没有减弱。我认为这就是将要发生的事情。但经济衰退无法解决根本问题,我们的美元购买的实际资源越来越少,因为实际资源越来越难开采,而我们的美元购买的产品越来越少,因为产品越来越难获得。我认为这将是一个十年的滞涨,我不认为经济衰退会打败通货膨胀。

福布斯:除了下跌,你有看到加密领域哪些增长趋势吗?

Carter :现在每个本是「地头蛇」的加密机构都在被掠夺或摧毁。行业的中坚分子都被榨干了。Terra 是第四大项目,它和其算法稳定币都被摧毁了。三箭资本是整个加密行业最大的私有基金,但 Voyager Digital 表示,如果该基金无法偿还贷款,它可能会发布违约通知。加密领域最大或第二大零售银行 Celsius 可能会破产。所以基本上整个杠杆和贷款的结构,以及 DeFi 和 CeFi 收益率之间的联系,都受到了市场的严厉质疑。可以说,过去两三年在加密领域建立起来的新银行结构正在被彻底摧毁。

未来 DeFi 的基础(包括收益率)不会是这种虚假的庞氏循环游戏、再质押和证券化,而是必须以实际经济收益为基础。

福布斯:有调查显示,70% 到 80% 的 DeFi 活动纯属投机。为什么泡沫如此之大?

Carter :我认为应该对 DeFi 有高标准严要求,因为它所追求的目标非常重要。我相信 DeFi,它应是去中介化的透明金融。然而,它在执行方面做得很糟糕。有很多构建,但没有经过思考。比如,将客户存款置于高风险的 DeFi 协议中,就像 UST 和 Anchor 发生的那样。我想对行业从业者说,没有思考,相当于在早期埋下隐患。

福布斯:熊市是创造财富的好时期吗?现在大投资者应该把钱放在哪里?

Carter :我们会继续执行既定战略——早期风投。许多一二级市场基金将中止其加密策略。很多加密基金在今年剩下的时间里不会再做交易,因为它们对市场状况过于担忧。

关于流动性危机,其实我们还没有真正陷入危机,但可能正朝着那个方向发展。在流动性危机中,你没有流动性,所以不能将自己与市场环境脱钩。除非你真的做好了准备,不然容易全军覆没。现在的一些加密基金和对冲基金要面对赎回,接下来是风险基金,它们要面对 LP,告诉它们不要进行资本调用。风险基金并不是在第一天就得到所有的资金。

LP 可能会感到苦恼,他们可能不想向加密货币或早期风险投资分配更多资金,即使他们签署了有限合伙协议,他们也有法律义务。所有你在场外看到的备用基金,这些筹集的资金可能并没有真正投入使用,类似的事情在 08 年和 01 年发生在风投领域。尤其是在估值下降的情况下,我认为市场活动会减少,而这种逢低买入可能受到机构约束。

福布斯:你对散户的投资方式有什么建议?

Carter :实际上现在最好的仓位是现金。

考虑整个资产领域,而不仅仅是加密货币;考虑固定收益以及股票和房地产商品之间的相对价值。传统市场还没有出现大量的资金缩水,我会考虑购买上市股票。在 1 万亿美元的市值之下,所有加密货币似乎都相当便宜,但没有基本的估值方法。比特币总价值 4000 亿美元,还不到黄金总价值的 1/20。从长远来看,我认为比特币作为社会储蓄工具的重要性可能会超过黄金。

这些价格很有吸引力,尤其是对比特币和现在的 L1。所有以太坊的竞争对手在去年度过了重要的一年。这些叙事在今年将受到真正的挑战。它们之所以受欢迎,是因为以太坊区块空间的需求大,这种需求蔓延到了其他链,特别是 EVM 兼容链,但其他类似以太坊的智能合约链,在未来不会有这种区块空间需求,这具有周期性。

以太坊正在走向合并,转向 PoS 并插入质押协议,这确实会给所有竞争对手带来很大压力。我会谨慎投资名单,或者关注去年非常热门的 L1。

目前这种情况下,流动性继续恶化,美联储加息还看不到结束的迹象。加密市场的情况可能会变得更糟。违约的放款人和大型基金在蔓延。

你最好的仓位战术是拿现金观望,不必一直活跃;我也会关注流动性最强、质量最高的公司,以及内部杠杆率最低的公司。

福布斯:你说的「内部杠杆」是什么意思?

Carter :很多事情都是建立在一套定义好的协议的基础上,这些协议使用 L1 基础资产作为质押品。这些协议锁定的总价值正在增长。这导致了供应锁定,Token的单位被锁定,然后市场浮动合约,这推动了Token的价格。当市场去杠杆化,被锁定的总价值下降时,质押品被抛出,重新回到公开市场。同时,这些协议中有很多都是风险投资支持的,这意味着有归属权,所以锁仓上有大量供应。大量流动性出现在网络上,是因为投资该协议的风险基金必须清算其头寸,尤其是现在。

另一个巨大的抛压来源是这些协议的机构支持者的流动性被锁定在这些授予权中,这些流动性将会被吐回市场。没有人想要持有,因为我们正处于大幅抛售的时期。几乎每个投资于 L1 的人投资于这些不同的Token,这是机构配置者的行为,他们将在投资后立即清算这些Token。任何不太成熟的公司都试图通过机构支持和建立 DeFi 生态系统来建立自己的公司,我认为这些公司在这个低迷的市场阶段表现最差。

福布斯:加密机构「传染病」会如何传播,往什么方向发展?

Carter :我对三箭事件感到震惊。对于 Celsius 和 Terra 崩溃我并不惊讶。很明显,Terra 是不稳健的,最终会崩溃。Celsius 多年来都处于红色信号,Celsius 是 DeFi 的积极参与者,所以他们会在 DeFi 中配置客户资金。我完全没想到的是三箭资本。

这些中心化的贷款机构和参与者在 DeFi 中注入了大量流动性,而这些 DeFi 的很多结构都是庞氏结构,注定会失败,但并没有阻止很多实体参与到这个系统中。实际上有很多相互关联,甚至像 Celsius 这样的中心化放贷者也受到了影响。但是,其他向这些私有公司提供贷款的中央银行现在可能缺乏流动性或资不抵债,现在也受到了影响。

现在他们的资产负债表上出现了一个漏洞。在我看来,这个行业中最大的机构都有资产负债表来吸收这些资金,所以最终它们会安然无恙。Celsius 在海外有一个 ICO 审查过的Token,他们把客户资金放在 DeFi。他们并不都遵循相同的风险管理标准,这很危险。有一些是在岸的,支持监管。我认为将会有更多资本充足的机构能够挺过这一关。

福布斯:对那些仍然想通过持有加密资产获得被动收益的投资者来说,最好的方法是什么?

Carter :在美国,基本上所有的散户贷款渠道都被美国证券交易委员会封锁了,这是监管问题。其他国家仍然有很多选择。现在,你必须非常小心收益率。有些人喜欢把炒期权 的所得称为收益率。我不考虑这种收益率,这只是提升了风险头寸。有很多供应商会让你做结构化产品,风险极大,尤其是对散户投资者而言。所以在我看来,这实际上并没有获得收益。你只是大大地改变了你投资的风险程度。别光盯着收益率。

另外,质押就像反稀释收益率一样。实际收益率是基于实际经济活动的。你给某人贷款,他们正在进行某种风险投资。有失败的风险,但你会得到补偿。如果经济活动是有生产力的,他们会给你回报。

福布斯:除了交易,你关注的 DeFi 的「实体经济活动」是什么?

Carter :现在越来越多的协议将加密货币资金投入到现实世界的借贷中。做小额信贷的 Goldfinch 就是一个例子。不同的贷款机构开始着眼于外部市场,而不仅仅是向其他 DeFi 市场参与者放贷,例如 Maple。它正在推出一个专注于比特币矿工的矿池,我认为他们会扩展业务,让挖矿变得更加复杂。

矿工们想要对冲风险敞口,可能只是想锁定一个在未来一年收益 20% 的利率,而不是暴露在比特币价格的影响之下,这是一个有趣的模型。我希望看到 DeFi 上存在更多这样的协议。它们确实设想到真正的经济活动,创造了对生产者和消费者有用的结构。

福布斯:DeFi 的去中心化治理真能发挥作用吗?我们看到许多协议的流动性危机,stETH 和 ETH 之间的 Curve 池正在枯竭。

Carter :我认为去中心化治理是一个矛盾的术语。如果你的治理意味着中心化,在股权的情况下,股东是公司的所有者。他们应该实施治理——这是他们的责任和权利。在协议之下,如果有质押者、Token 持有人在进行治理,这必然意味着它不是去中心化的。因为加密玩家对公司治理一无所知。对于一大群小型Token持有者或股东来说,没有执行治理的动机,因为治理需要收集重要的信息才能发挥作用。

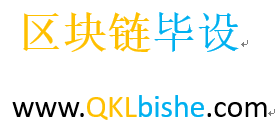

这就是为什么要有风投。需要有大股东来掌管公司治理。因此,拥有高度分布式的Token持有者意味着没有治理,没有监督。在企业环境中,董事即操作协议的人。分散的治理基本上意味着治理不起作用。集中治理中有一两个实体负责信息收集和监督,确保系统协议的管理者不会征用系统,因为这是公司治理存在的一个重要原因,这需要中心化的代理。实际上,在 DeFi 中持有大量Token敞口的是大型风投基金。他们隐藏自己的投资足迹,因为他们不想让监管知道他们的投资方向。

如果你想真正实施管理,需要保持动态和变化,那么它将是中心化的。如果你的协议是静态的,并且不更改,那么就不需要那么多的治理。在我看来,那就是你可以拥有完全的真正的去中心化的时候。比特币不会经常变化,所以没有太多的决策需要做,这是去中心化。但除了比特币之外,没有那么多协议能够真正做到,并将治理最小化。

福布斯:加密行业接下来将面对什么?

Carter :我认为未来行业监管将是严厉的,加密参与者最好是欢迎接下来出台的政策。如果你在 Celsius 或 Terra 或黑客事件中受到了损失,监管对你来说不是坏事。金融危机后,总会迎来更多的监管。这就是市场的运行方式。