Blockchain Academy 2022 BuidlCamp 正式启动

随着区块链技术的高速发展,Web3.0的概念已经成为了当今的风潮,公众进入该领域的需求也应运而生。作为专注于Web3.0教育的大型平台,Blockchain Academy与香港科技大学区块链中心联合多方举办BuidlCamp,即集教育、比赛、求职为一体的大型Web3.0活动。

此次活动营员规模已超过1000人,集结了来自香港科技大学、香港大学、香港中文大学、清华大学、北京大学、浙江大学、新加坡国立大学、南洋理工大学、耶鲁大学、剑桥大学等30多所顶级高校的学子。活动还有多名教授参与,包括香港科技大学汪扬副校长、香港科技大学区块链中心主任陈卡你教授、香港中文大学及北京大学客座教授劳维信教授、香港理工大学商学院教授、内地事务发展主任陆海天教授、纽约大学教授兼Ledger Prime COO Ayesha Kiani教授、 伦敦国王学院教授 Alex Preda教授、香港中文大学(深圳)人云系统实验室主任蔡玮教授等。而参与的机构则有登月工坊、香港区块链协会、M-Ventures、GeekCartel、AWS、Blackpine、分布式资本、CMT Digital、真格基金、GBV、JLL、PANONY等,同时PANews也将作为官方合作媒体为此次活动提供支持。

多样的文化、想法与科技在区块链世界中交融,碰撞出精彩纷呈的思维火花,也为Web3.0领域的蓬勃发展创造了新的机遇。作为顶尖学府,香港科技大学始终致力于探索前沿技术,把握并引领数码时代趋势的走向。2022年八月,香港科技大学宣布在元宇宙建立世界首个实体-数字双子校园,并将与众多机构合作,积极推动元宇宙校园的建设。

港科大副校长汪扬教授表示:“实体和虚拟世界正急速融合,我认为,在这个势将颠覆未来的Web 3.0时代,香港具备了所有发展与契合的要素。港科大作为我相信是全球第一所建立实体-数字双子校园的大学,我们已准备好带领创造一个可持续发展的XR生态系统,推动研发和学习。这种在线线下的互动,不仅有利于两校园在「港科大一体,双校互补」的框架下真正融合,亦有助把元宇宙的发展潜能带到教育当中”。处于如此开放支持的环境中,香港科技大学区块链中心吸纳了众多区块链专家与爱好者,并促进了数个去中心化项目的诞生,已获得累计超过1亿2千万港币投资。

作为香港科技大学区块链实验室发起的公益组织,Blockchain Academy集结了最前瞻的科技视野和最顶尖的教学资源,也肩负了传播Web3.0知识的重要使命。Blockchain Academy的面向用户不受地域或年龄限制,任何想进入Web3.0世界的求知者都可以成为Blockchain Academy的听众,学习加密世界的基本概念、实用技能和思维模式。

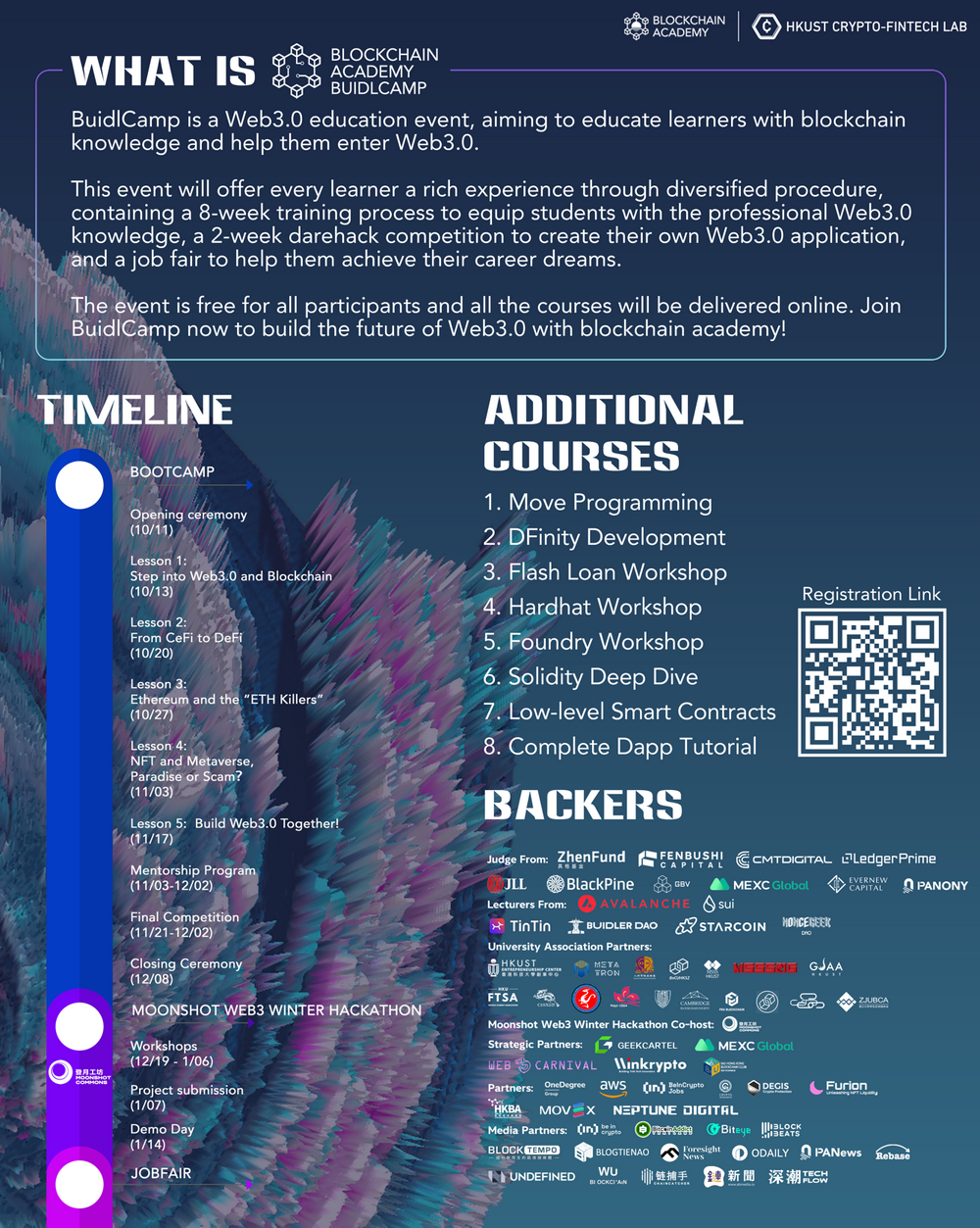

作为Blockchain Academy的首个教育活动,BuidlCamp不仅在课程设置与嘉宾邀请上覆盖了区块链技术的热门话题,更打破了传统培训营的框架,引入了比赛、求职等元素,在注重技能实践运用的同时使培训结构变得更加立体与完整。从区块链世界的概览到不同语言的生态系统,再到更深层的技术教学,来自Web3.0行业的精英及专业教授团队将由浅入深地带参与者领略Web3.0世界的全貌,呈现丰富的专业知识。

第二阶段的Moonshot Web3 Winter Hackathon 由Blockchain Academy, HKUST Crypto-Fintech Lab与登月工坊 Moonshot Commons 联合主办,既为营员提供了实践所学内容的机会,也提供了营员与Web3.0从业者直接交流的平台,让营员们对于项目的构想更加全面,乃至成为现实。为了给营员带来更多职业机遇,并为区块链行业输送优质人才,BuidlCamp也将举办一场求职大会,供营员们踏上属于自己的Web3.0之路。

BuidlCamp一经问世,便得到了众多海内外学府及区块链组织的持续关注。随着覆盖院校与地区的不断扩张,更多有意了解Web3.0和区块链的人将会加入BuidlCamp,成为Web3.0世界未来的建设者。

区块链作为网络时代的新兴技术,需要被更好地解释、传播给大众,而配套的教育体系更是任重道远。将优质的内容和教育资源不限门槛地输送给每一个人,是每个教育平台的终极目标,也是对于Web3.0世界来说最好的“破圈”方式。Web3.0行业的高速发展方才启程,每一位新加入Web3.0世界的建设者,都会是Web3.0繁荣未来中不可或缺的一环。

了解更多信息:

报名链接: